Tóm tắt nghiên cứu: Năm 2025, hơn 70% vụ lừa đảo tài chính lớn liên quan đến deepfake – công nghệ AI tạo video giả mạo giống thật đến 99.9%. Từ giả mạo CEO đến lừa tình cảm, deepfake đang làm lung lay nền tảng niềm tin số.

Mục tiêu bài viết

- Phân tích cơ chế deepfake và cách nó bị lạm dụng trong lừa đảo.

- Trình bày 5 hình thức lừa đảo deepfake phổ biến nhất 2025.

- Cung cấp công cụ phát hiện & phòng tránh thực tế.

- Dự báo xu hướng deepfake 2026 và giải pháp toàn cầu.

1. Bối cảnh & Vấn đề

Câu hỏi nghiên cứu: Khi AI có thể giả mạo bất kỳ ai chỉ trong vài giây, làm sao để tin vào những gì ta thấy?

- Thống kê 2025 (FBI Cyber Division): Lừa đảo deepfake gây thiệt hại 2.1 tỷ USD – tăng 300% so với 2023.

- Công cụ dễ tiếp cận: Các app deepfake miễn phí như DeepFaceLive, FaceSwap có hơn 10 triệu lượt tải.

- Tâm lý nạn nhân: 87% tin video call là thật nếu thấy mặt người quen – dù chỉ 3 giây.

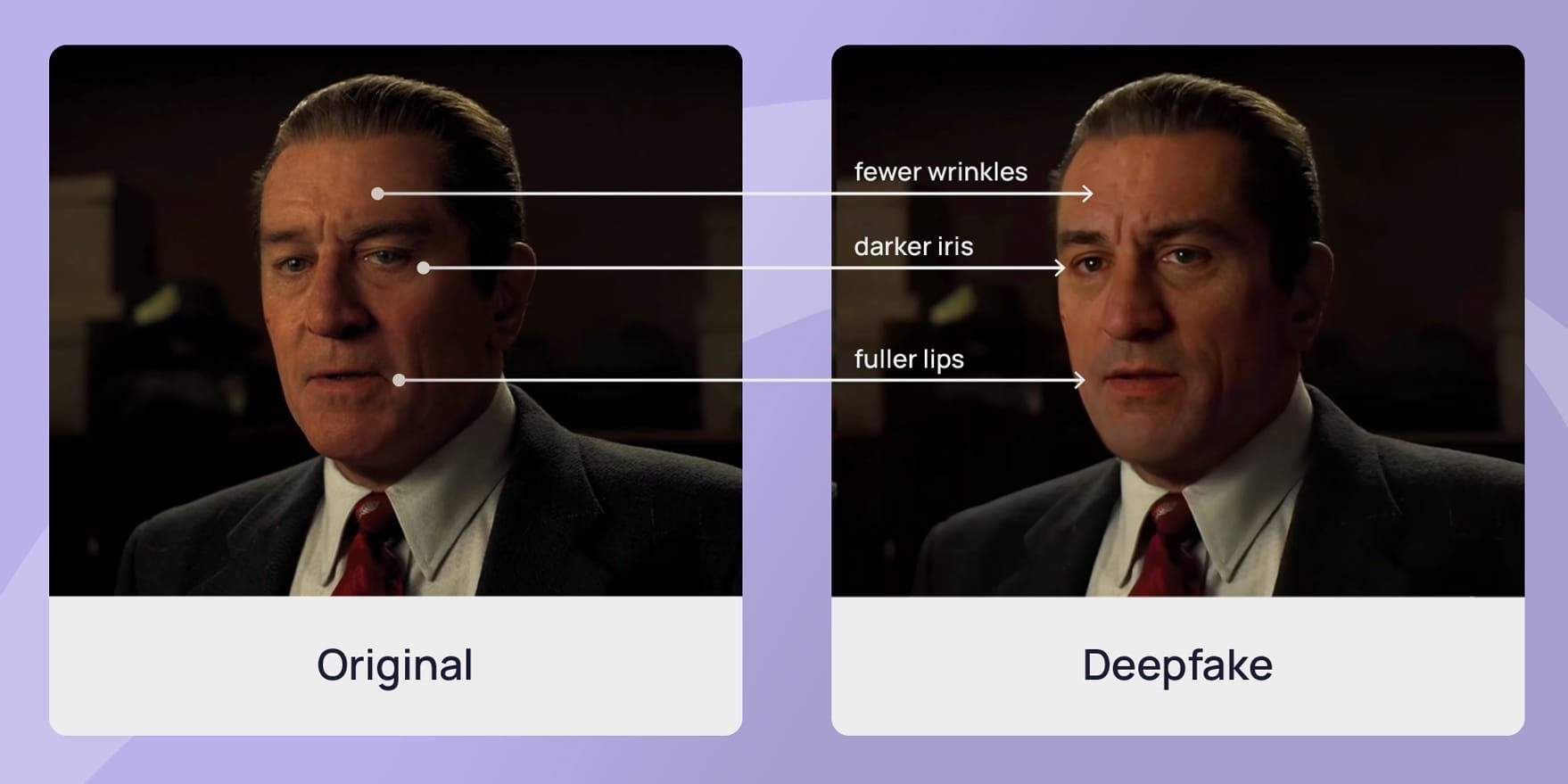

2. Deepfake Là Gì? (Giải Thích Đơn Giản)

| Thành phần | Mô tả |

|---|---|

| GANs | Mạng sinh tạo đối kháng – học cách tạo khuôn mặt giả |

| Training Data | Cần 100+ ảnh/video của nạn nhân |

| Real-time Swap | Thay mặt trong video call (chỉ cần 1 GPU) |

Ví dụ thực tế: Một đoạn video 10 giây của bạn bè có thể tạo deepfake hoàn chỉnh trong 15 phút.

3. 5 Hình Thức Lừa Đảo Deepfake Phổ Biến Nhất 2025

3.1 Lừa Đảo Video Call Giả Mạo CEO (CEO Fraud 2.0)

- Kịch bản: Kẻ lừa giả mạo CEO trong Zoom/Teams, yêu cầu chuyển tiền khẩn cấp.

- Ví dụ thực tế: Vụ Hồng Kông 2024 – nhân viên chuyển 25 triệu USD sau cuộc họp deepfake.

- Công cụ dùng: DeepFaceLive + voice cloning (ElevenLabs).

3.2 Lừa Đảo Tình Cảm (Romance Scam AI)

- Kịch bản: Tạo video giả người yêu nước ngoài, xây dựng lòng tin → xin tiền.

- Thiệt hại: Trung bình 50.000 USD/nạn nhân – chủ yếu người lớn tuổi.

3.3 Giả Mạo Người Nổi Tiếng Quảng Cáo Lừa Đảo

- Ví dụ: Deepfake Elon Musk kêu gọi đầu tư crypto → hàng nghìn người mất tiền.

- Nền tảng: TikTok, YouTube Shorts, Facebook Ads.

3.4 Tống Tiền Bằng Video Nhạy Cảm Giả (Sextortion 2.0)

- Kịch bản: Ghép mặt nạn nhân vào video khiêu dâm → đe dọa phát tán.

- Tâm lý: 60% nạn nhân trả tiền ngay lập tức.

3.5 Lừa Đảo Ngân Hàng Qua Video Xác Thực

- Kịch bản: Giả mạo khách hàng trong video call để mở tài khoản mới hoặc rút tiền.

- Ngân hàng bị ảnh hưởng: Việt Nam, Singapore, Mỹ.

4. Cách Phát Hiện Deepfake (Mẹo Thực Tế)

| Dấu hiệu | Mô tả |

|---|---|

| Môi không khớp lời nói | Độ trễ >0.3s, miệng méo |

| Ánh sáng bất thường | Bóng mặt không khớp nền |

| Cử chỉ không tự nhiên | Nháy mắt đều, thiếu biểu cảm vi mô |

| Nền mờ bất thường | Do AI che khuyết điểm |

Công cụ miễn phí phát hiện:

5. Biện Pháp Phòng Tránh Hiệu Quả

5.1 Cá nhân

- Không bao giờ chuyển tiền chỉ dựa trên video call

- Dùng mã xác nhận bí mật với người thân (ví dụ: “Mật khẩu gia đình là gì?”)

- Kích hoạt xác thực sinh trắc học hành vi (keystroke, giọng nói)

5.2 Doanh nghiệp

- Cấm chuyển khoản khẩn cấp qua video call

- Áp dụng AI detection trong họp trực tuyến (Zoom, Teams plugin)

- Đào tạo nhân viên nhận diện deepfake hàng quý

5.3 Chính phủ & Nền tảng

- Cấm quảng cáo deepfake (TikTok, Meta đã bắt đầu)

- Xây dựng hệ thống xác thực video quốc gia

- Phạt nặng hành vi tạo deepfake lừa đảo

6. Dự Báo Xu Hướng Deepfake 2026

| Xu hướng | Dự đoán |

|---|---|

| Deepfake thời gian thực 4K | AI tạo video 60fps, không lag |

| Voice + Face + Cử chỉ | Giả mạo toàn diện, không phát hiện nổi |

| Lừa đảo chính trị | Video giả lãnh đạo tuyên chiến |

| Giải pháp | Blockchain video, watermark AI, luật toàn cầu |

Kết luận: Deepfake không còn là tương lai – nó là hiện tại. Chỉ có nhận thức + công nghệ + pháp luật mới ngăn được làn sóng lừa đảo này.

Bạn đã từng gặp deepfake chưa? Chia sẻ kinh nghiệm bên dưới để cùng cảnh giác!